Команда ученых из США обнаружила особенность, которая может гарантированно отличить дипфейки от фотографий реальных людей. Исследование опубликовано на сайте arXiv.org.

В последние годы в Интернете стали очень распространены дипфейки (deepfake) — фотографии и видео, "смонтированные" машинными алгоритмами. К примеру, известный актер может заниматься вещами, которые никогда не делал в жизни. Более того, искусственный интеллект научился создавать изображения людей, никогда не существовавших.

На первый взгляд может показаться, будто все это просто веселая забава, однако злоумышленники используют сгенерированные компьютером изображения, чтобы выдавать себя за других или скрывать свою личность в социальных сетях. Технология настолько развилась, что практически невозможно определить подделку по внешнему виду. К счастью, исследователи из Университета в Олбани, Университета в Баффало и компании Keya Medical нашли критический изъян.

Искусственные лица создаются с помощью генеративно-состязательных нейросетей (GAN), которые обучаются на настоящих фотографиях, потом создают свои изображения на их основе. Готовые лица отправляют в другую нейросеть которая проверяет подлинность и отправляет фальшивые на доработку. Процедура повторяется несколько раз, пока дипфейки не становятся максимально реалистичными.

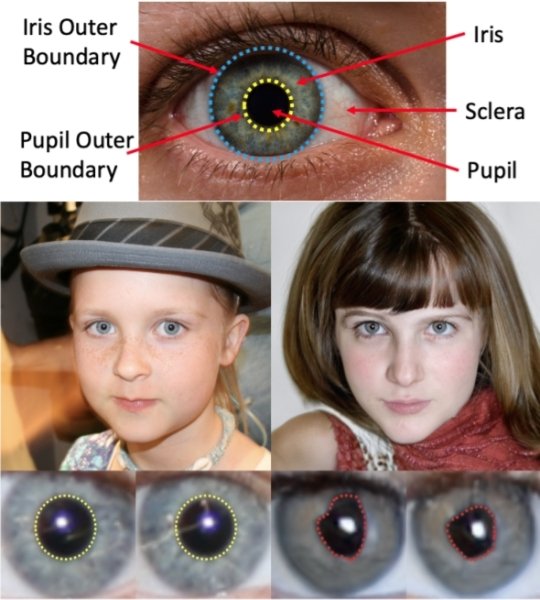

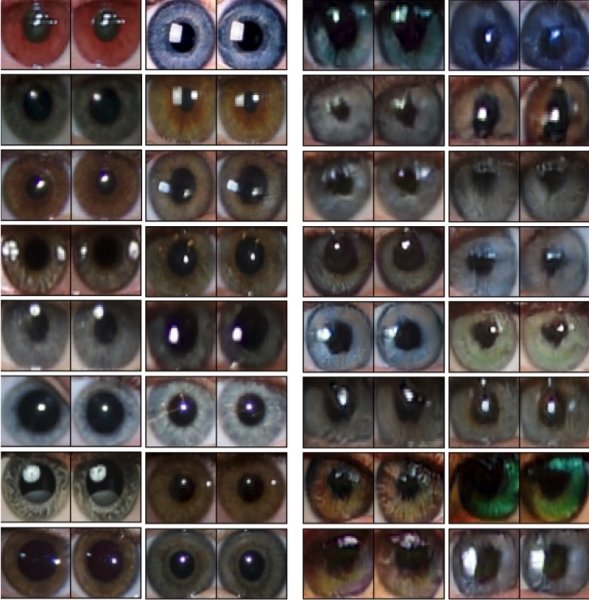

Авторы исследования выявили, что большинство GAN рисуют не круглые зрачки из-за отсутствия физиологических ограничений. В итоге даже самые качественные дипфейки имеют глаза неправильной формы. При желании, любой пользователь может приблизить изображение и обнаружить отклонения. Кроме того, ученые предлагают написать программу, которая будет автоматически выявлять неровности в форме зрачков.

"Неправильная форма зрачка — хороший знак для человека, чтобы визуально обнажить лицо, созданное GAN, даже если нет граничных меток вокруг зрачков, мы можем легко увидеть, что формы зрачков, генерируемых GAN, очень неправильны, а формы обоих зрачков сильно различаются на одном и том же изображении лица, созданном GAN", — отмечают ученые.